빠른 시작

이 가이드에서는 NuFi에 처음 로그인한 뒤 AI 모델을 배포하고 테스트하는 전 과정을 5단계로 안내합니다.

소요 시간: 약 10분 (모델 로딩 시간 제외)

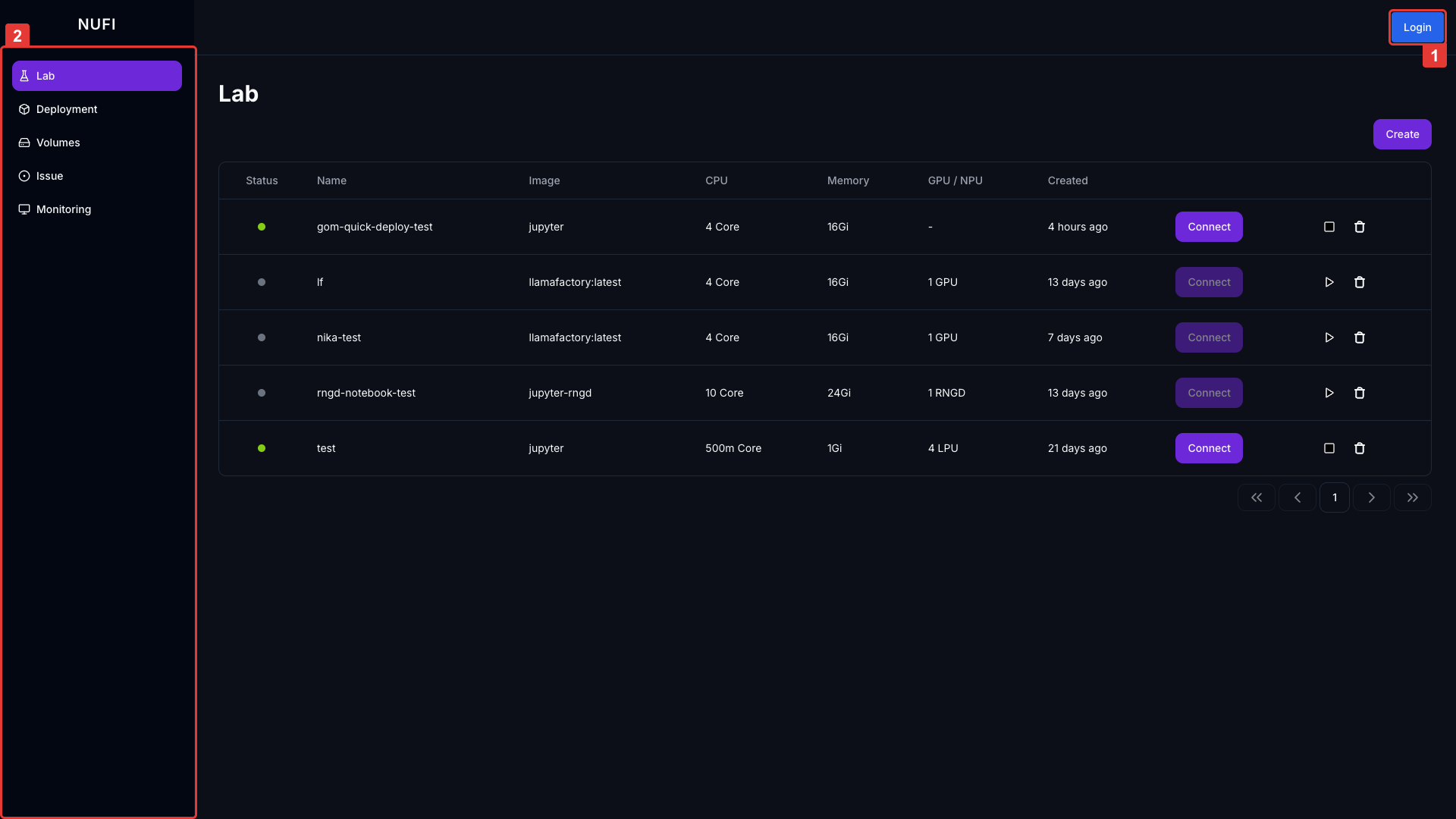

1단계: 로그인

우측 상단의 ① Login 버튼을 클릭합니다. OAuth 기반 인증을 지원합니다.

로그인 후 상단 헤더에 프로젝트 선택 드롭다운이 활성화됩니다.

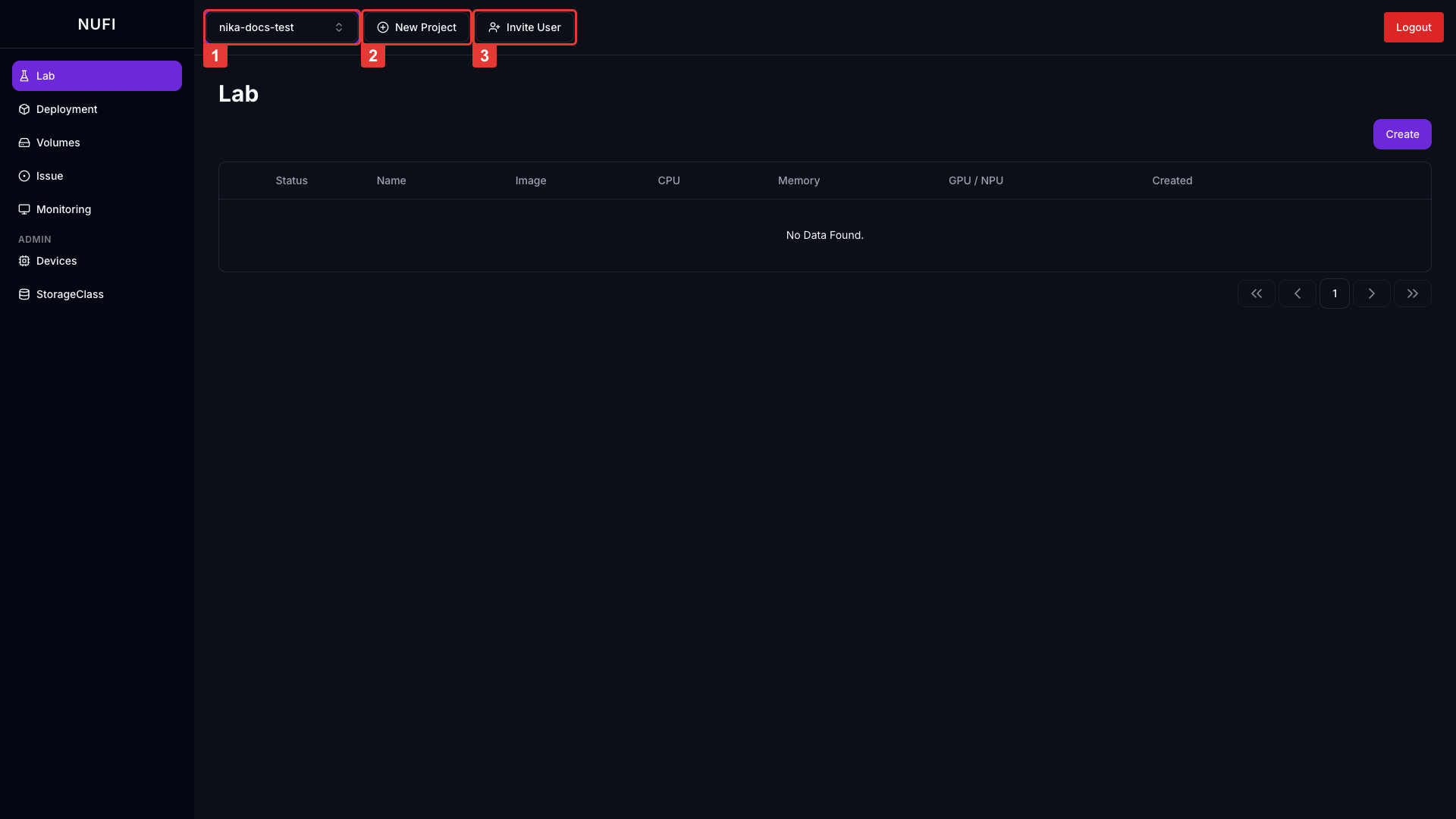

2단계: 프로젝트 생성

프로젝트는 리소스 격리 단위입니다. Lab, Deployment, Volume은 모두 프로젝트 단위로 관리됩니다.

- 상단 헤더의 ② New Project 버튼을 클릭합니다.

- 프로젝트 이름을 입력합니다.

- 소문자, 숫자, 하이픈(-) 사용 / 3자 이상 (예:

my-first-project)

- 소문자, 숫자, 하이픈(-) 사용 / 3자 이상 (예:

- Create 버튼을 클릭합니다.

생성된 프로젝트가 드롭다운에 자동으로 선택됩니다.

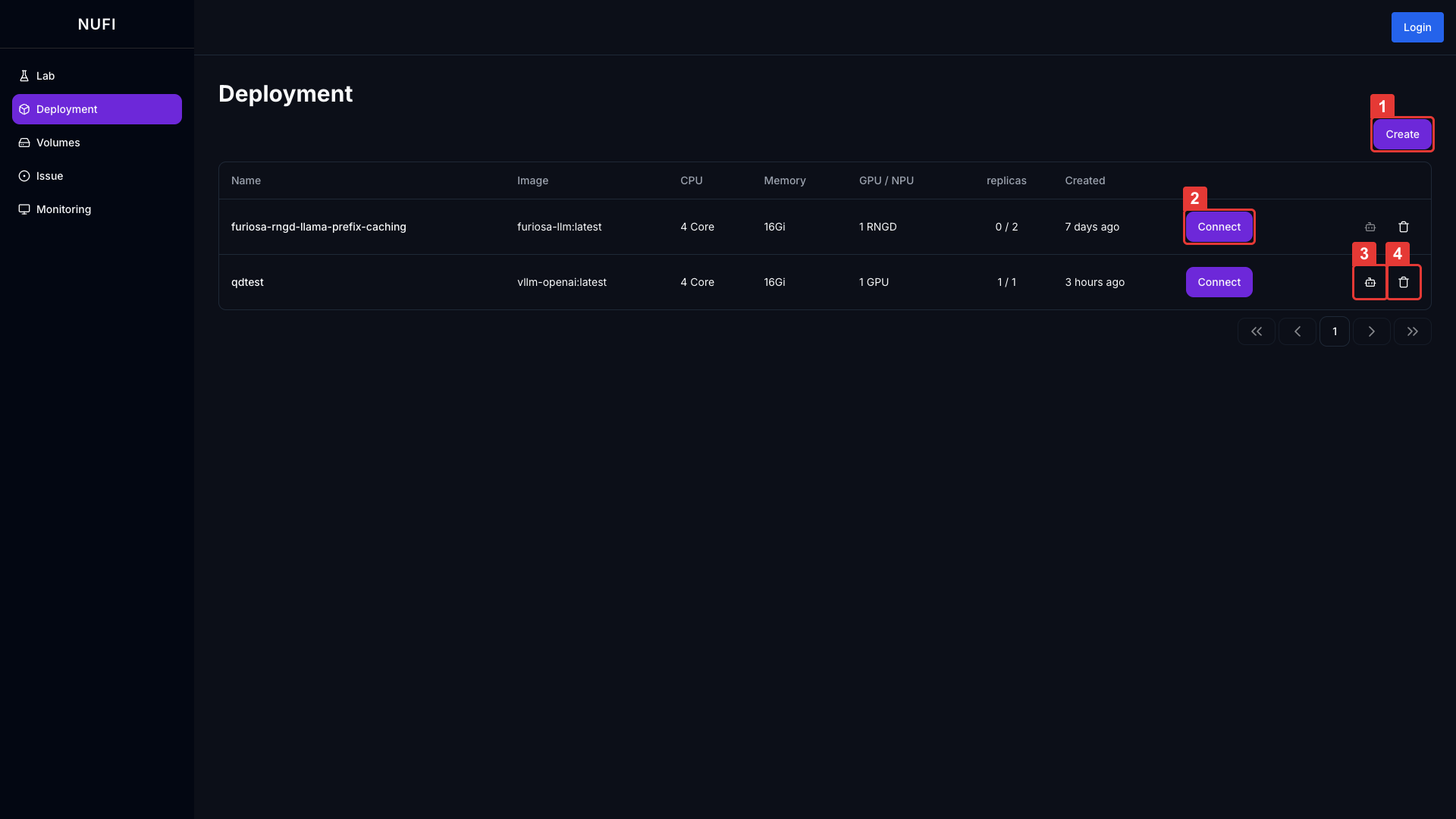

3단계: 모델 배포

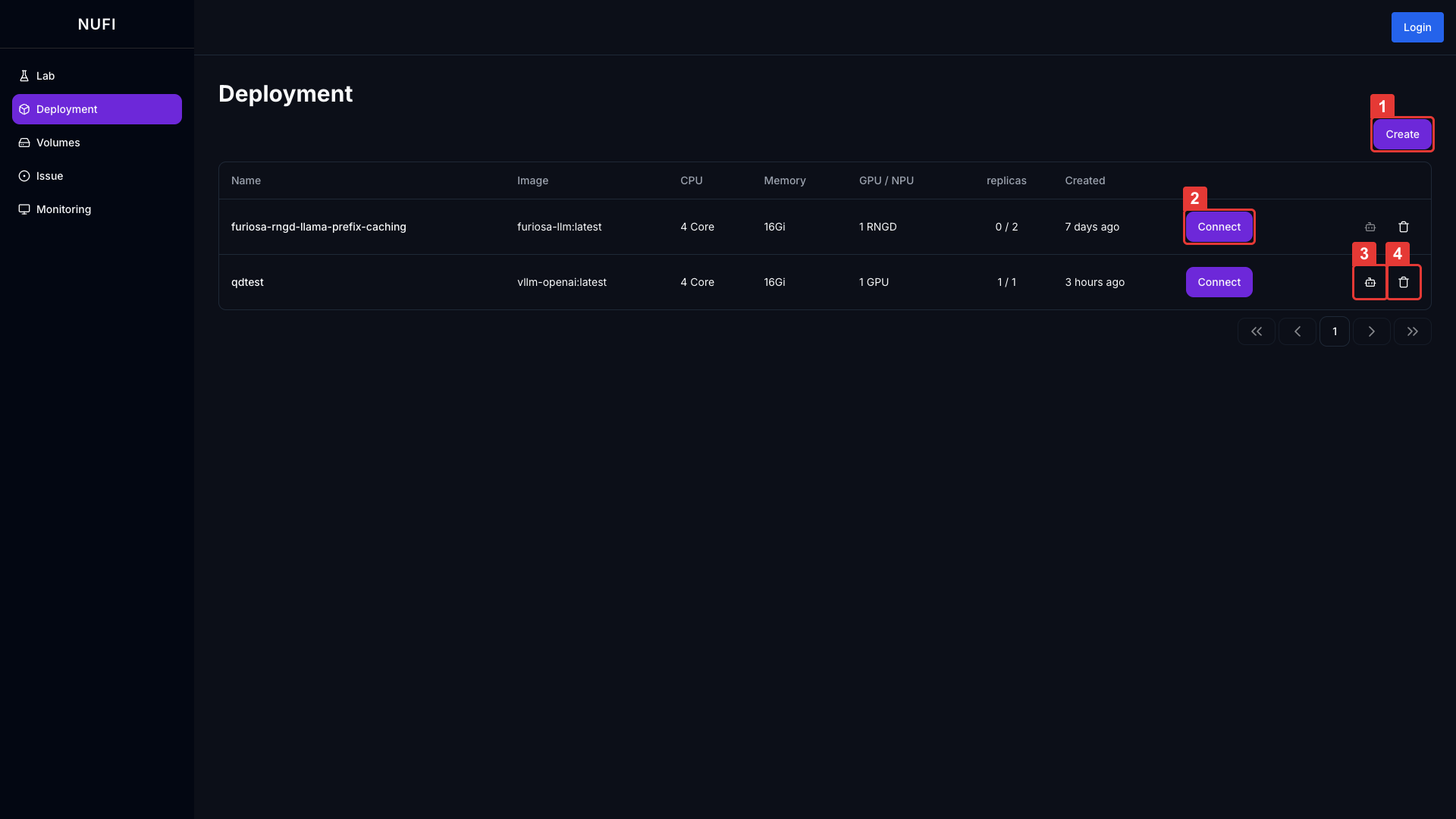

좌측 사이드바에서 Deployment를 클릭합니다.

- ① Create 버튼을 클릭합니다.

- Step 1 — 기본 정보를 입력합니다.

- Service Name: 배포 이름 (예:

llm-demo) - Service Template: 사용할 추론 프레임워크 선택 (예:

vLLM)

- Service Name: 배포 이름 (예:

- Next를 클릭하고 Step 2 — 상세 설정으로 이동합니다.

- Image: 추론 서버 컨테이너 이미지 선택

- Accelerator Type / Count: 사용할 GPU 또는 NPU 선택

- vLLM 사용 시 Model 필드에 Huggingface 모델 이름

Qwen/Qwen3.5-0.8B입력

- Next를 클릭하고 Step 3 — 리뷰 & 배포에서 설정을 확인합니다.

- 배포 버튼을 클릭합니다.

Deployment 목록으로 돌아오면 상태가 Pending → Running으로 변경됩니다. 모델 로딩까지 수 분이 소요될 수 있습니다.

4단계: Playground에서 테스트

상태가 Running이 되면 Playground 버튼이 활성화됩니다.

- Deployment 목록에서 ③ Playground 버튼을 클릭합니다.

- 채팅 UI에서 메시지를 입력하여 모델 응답을 확인합니다.

5단계: API 엔드포인트 확인

배포된 모델은 OpenAI 호환 API 엔드포인트를 제공합니다.

② Connect 버튼을 클릭하면 엔드포인트 URL을 확인할 수 있습니다.

curl -X POST 'https://<deployment-endpoint>/v1/chat/completions' \

-H 'Content-Type: application/json' \

-d '{

"model": "Qwen/Qwen3.5-0.8B",

"messages": [{"role": "user", "content": "안녕하세요"}]

}'

다음 단계

- 개발 환경 구성하기 — Lab으로 Jupyter/VS Code 개발 환경 시작

- 모델 배포하기 — 배포 옵션 상세 설정

- 모니터링하기 — GPU/NPU 디바이스 사용률 및 클러스터 상태 확인